Anthropic AI taucht in Besprechungen genauso auf wie ein neuer Mitarbeiter: am ersten Tag spannend, am zweiten Tag etwas unberechenbar. Wir haben beobachtet, wie Teams um 23:47 Uhr chaotische Kunden-E-Mails in einen Chatbot einfügen und auf das Beste hoffen. Das funktioniert – bis es irgendwann nicht mehr funktioniert.

Kurze Antwort: Anthropic AI (vor allem bekannt für Claude) kann bei der Erstellung von Inhalten, im Support und in Backoffice-Abläufen Zeit sparen, aber die Vorteile kommen erst dann zum Tragen, wenn man zunächst Sicherheitsvorkehrungen trifft und Eingabeaufforderungen wie Betriebsanweisungen behandelt.

Das Wichtigste in Kürze

- Anthropic AI (Claude) spart Zeit bei der Erstellung von Inhalten, im Support und bei Backoffice-Aufgaben, wenn Sie Eingabeaufforderungen wie Standardarbeitsanweisungen behandeln und Leitplanken festlegen, bevor Sie irgendetwas automatisieren.

- Anthropic AI ist kein allwissender Mitarbeiter – Claude generiert Textvorschläge, daher müssen Sie ihm verifizierte geschäftliche Fakten zur Verfügung stellen oder ihn mit vertrauenswürdigen Systemen verknüpfen, um Fehler zu vermeiden.

- Wenden Sie den „Safety-First“-Ansatz von Anthropic (Constitutional AI) in realen Arbeitsabläufen an, indem Sie Systeme so gestalten, dass sie Ablehnungen, menschliche Überprüfung und Datenminimierung ermöglichen, um Risiken zu verringern und das Vertrauen zu stärken.

- Für WordPress- und WooCommerce-Teams eignet sich Claude am besten für Content-Operationen, die ausschließlich Entwürfe betreffen, für Ticketzusammenfassungen und die Vergabe von Tags sowie für die Klassifizierung von Dokumenten, bei denen strukturierte Eingaben zu konsistenten Ergebnissen führen.

- Schützen Sie die Privatsphäre in regulierten Anwendungsfällen, indem Sie vertrauliche Daten niemals einfügen, Eingaben schwärzen, rollenbasierten Zugriff durchsetzen und dafür sorgen, dass Menschen weiterhin für rechtliche, klinische und finanzielle Entscheidungen verantwortlich sind.

- Implementieren Sie Anthropic AI mithilfe eines „Workflow-First“-Leitfadens – ordnen Sie Trigger → Eingabe → Job → Ausgabe → Sicherheitsvorkehrungen zu, führen Sie den Schattenmodus aus, prüfen Sie die Ergebnisse und fügen Sie Protokollierungs- und Rollback-Pläne hinzu, bevor Sie die Skalierung vornehmen.

Was anthropische KI ist (und was sie nicht ist)

Anthropic ist ein auf KI-Sicherheit und -Forschung spezialisiertes Unternehmen mit Sitz in San Francisco. Es wurde 2021 gegründet, unter anderem von den ehemaligen OpenAI-Führungskräften Dario Amodei (CEO) und Daniela Amodei (Präsidentin). Anthropic entwickelt unter dem Namen Claude große Sprachmodelle (LLMs) und betrachtet „Sicherheit“ als eine Produktanforderung erster Ordnung, nicht als Nebenaufgabe. Anthropic agiert zudem als gemeinnütziges Unternehmen, was auf eine Mission hindeutet, die nicht nur auf Gewinn, sondern auch auf das öffentliche Interesse ausgerichtet ist.

Anthropic AI ist kein Zaubermitarbeiter. Claude generiert Texte. Das bedeutet, dass Claude Texte entwerfen, zusammenfassen, klassifizieren und umformulieren kann. Claude kann Ihre geschäftlichen Fakten nicht „kennen“, es sei denn, Sie stellen sie ihm zur Verfügung, verbinden ihn mit Ihren Systemen oder speisen ihm genehmigtes Wissen ein.

Hier ist der Grund, warum diese Definition wichtig ist: Modellgrenzen → Auswirkungen → Geschäftsrisiko. Wenn Ihr Team anthropische KI wie ein allwissendes Orakel behandelt, erhalten Sie im ungünstigsten Moment selbstbewussten Unsinn.

Anthropic im Vergleich zu anderen KI-Labors: Die entscheidenden praktischen Unterschiede

Wir sehen drei Unterschiede, die sich in der täglichen Arbeit zeigen:

- Sicherheitsausrichtung: Anthropic setzt auf Techniken wie „Constitutional AI“ (mehr dazu weiter unten). Dieser Ansatz -> beeinflusst -> die Art und Weise, wie das Modell unsichere Anfragen ablehnt, und wie konsistent sich das Modell bei verschiedenen Eingabeaufforderungen verhält.

- Unternehmensweites Routing: Claude läuft über die API von Anthropic und ist zudem über Partner wie Amazon Bedrock verfügbar. Dieses Partner-Ökosystem -> beeinflusst -> die Beschaffung, die Abrechnung und den Weg, den Ihre Daten nehmen.

- Richtlinienbeschränkungen: Anthropic schränkt den Zugang in bestimmten Ländern aus Sicherheitsgründen ein. Diese Einschränkungen -> wirken sich -> auf die weltweite Einführung und die Anbieterauswahl für multinationale Teams aus.

Wenn Sie bereits Modelle von OpenAI oder Google verwenden, sollten Sie die Frage nicht so formulieren: „Welches Modell ist besser?“, sondern: „Welches Modell passt zu diesem Arbeitsablauf bei einem akzeptablen Risiko?“

Das Anthropic-Modellangebot in einfachen Worten: Claude, Tools und Kontextfenster

Einfach ausgedrückt: Claude ist die ideale Familie. Die Interaktion erfolgt über Chat-Apps, eine Weboberfläche oder eine API.

Zwei Funktionen bestimmen, was Sie automatisieren können:

- Große Kontextfenster: Claude unterstützt in einigen Modellen sehr umfangreiche Eingaben, die üblicherweise bei etwa 200.000 Token liegen. Ein langer Kontext wirkt sich positiv auf Aufgaben wie die Zusammenfassung umfangreicher Richtlinien, die Durchsicht langer Sitzungsprotokolle oder den Vergleich von Vertragsversionen aus.

- Werkzeugnutzung und agentenähnliche Arbeitsabläufe: Anthropic hat die Programmierung und Agentenerfahrungen wie Claude Code vorangetrieben. Die Werkzeugnutzung beeinflusst, ob Claude strukturierte Schritte ausführen kann (eine API aufrufen, eine Datei überprüfen, einen Patch entwerfen), anstatt nur zu chatten.

Wenn Sie WordPress oder WooCommerce nutzen, lautet die praktische Frage: „Können wir Claude zum richtigen Zeitpunkt den richtigen Teil des Inhalts mit den richtigen Schwärzungen zur Verfügung stellen?“ Wenn ja, können Sie die langweiligen Aufgaben automatisieren, ohne die Kontrolle zu verlieren.

So funktioniert der Sicherheitsansatz von Anthropic: „Constitutional AI“ und „Guardrails“

Anthropic AI spricht über Sicherheit auf eine Weise, die uns gefällt: Das Unternehmen versucht, Regeln direkt in das Verhalten des Modells zu integrieren, anstatt sie erst nach dem Auftreten von Problemen anzufügen.

Constitutional AI stützt sich auf schriftlich festgelegte Grundsätze (eine „Verfassung“), um das Training und die Antworten des Modells zu steuern. Diese Grundsätze beeinflussen die Ablehnungen, den Tonfall und den Umgang des Modells mit Grauzonen. Anthropic forscht zudem im Bereich der Interpretierbarkeit, um das Verhalten des Modells leichter überprüfbar und verständlicher zu machen.

Was „Sicherheit geht vor“ in der Praxis bedeutet

„Sicherheit geht vor“ ist nur dann von Bedeutung, wenn es die Art und Weise verändert, wie Sie Arbeitsabläufe gestalten.

Das bedeutet in der Praxis Folgendes:

- Sie entwickeln das System so, dass es Ablehnungen vorsieht: Das Modell sollte „Nein“ sagen, wenn die Eingaben sensible Daten, medizinische Entscheidungen oder Anfragen nach Rechtsberatung enthalten.

- Sie gestalten im Hinblick auf die Überprüfung: Ein Mitarbeiter prüft die Ergebnisse, bevor sie veröffentlicht, versendet oder abgelegt werden.

- Man optimiert auf Minimierung: Man sendet die kleinstmögliche sinnvolle Eingabe.

Gestaltung der Arbeitsabläufe -> wirkt sich aus auf -> die Fehlerquote. Fehlerquote -> wirkt sich aus auf -> das Vertrauen. Vertrauen -> wirkt sich aus darauf, ob Ihr Team das System nutzt oder es umgeht.

Wenn Sie ein umfassenderes Rahmenkonzept für sichere Prompts, Kennzahlen und Governance suchen, das auf moderne Teams zugeschnitten ist, finden Sie in unserem Leitfaden zur Verbesserung von AIO für moderne Fachkräfte einen praktischen Ansatz. (Wir wenden dieselben Konzepte an, wenn wir mit WordPress verbundene Automatisierungen entwickeln.)

Datenschutz, Datenverarbeitung und regulierte Anwendungsfälle (Rechtswesen, Gesundheitswesen, Finanzwesen)

Wenn Sie in den Bereichen Recht, Gesundheitswesen, Finanzen oder Bildung tätig sind, sollten Sie Anthropic AI wie einen leistungsstarken Assistenten betrachten, der sich an klare Grenzen halten muss.

Unsere Regel: Fügen Sie niemals vertrauliche Informationen ein. Dazu gehören Patientendaten, Zahlungsdaten, vertrauliche Kundendokumente und alles, was Rückschlüsse auf eine Person zulässt, es sei denn, Sie verfügen über einen genehmigten, dokumentierten Prozess.

Mach stattdessen Folgendes:

- Geschwärzten Text senden. Schwärzung -> Auswirkungen -> Datenschutzrisiko.

- Verwenden Sie rollenbasierte Zugriffsrechte. Zugriffskontrollen -> Auswirkungen -> Insiderrisiken.

- Bei allen klinischen, rechtlichen oder finanziellen Angelegenheiten sollte immer ein menschlicher Entscheidungsträger involviert sein. Menschliche Aufsicht -> Auswirkungen -> Haftung.

Wenn Sie Leitlinien auf politischer Ebene benötigen, sollten Sie zunächst offizielle Quellen heranziehen, wie beispielsweise die Leitlinien der US-amerikanischen Federal Trade Commission für Unternehmen zu AI-Angaben und Transparenz.

Quellen

- „Anthropic“ (Unternehmensinformationen), Anthropic, abgerufen 2026, https://www.anthropic.com

- „Künstliche Intelligenz und Werbeaussagen: Leitlinien für Unternehmen“ (Leitlinien für Unternehmen zu Werbeaussagen im Zusammenhang mit KI), Federal Trade Commission, Februar 2023, https://www.ftc.gov/business-guidance/blog/2023/02/keep-your-ai-claims-check

Wo anthropische KI für WordPress- und E-Commerce-Teams einen Mehrwert bietet

Wir entwickeln viele WordPress- und WooCommerce-Lösungen, daher denken wir in Systemen: Was löst einen Vorgang aus, welche Daten werden übertragen und was passiert, wenn die Ausgabe fehlerhaft ist.

Anthropic AI spielt seine Stärken besonders dann aus, wenn sich die Spracharbeit stapelt und Menschen im Copy-Paste-Modus stecken bleiben.

Content-Management: Konzepte, Entwürfe, SEO-Unterstützung und Lektorat mit menschlicher Überprüfung

Claude kann Content-Teams dabei helfen, schneller voranzukommen, ohne unbrauchbare Inhalte zu veröffentlichen.

Gut geeignet:

- Eine Produktsseite in eine Gliederung umwandeln -> führt zu -> schnelleren ersten Entwürfen.

- Aus unübersichtlichen Notizen der Beteiligten -> wird -> ein klarer Auftrag.

- Einen 2.000-Wort-Entwurf überarbeiten -> Auswirkungen -> straffere Überarbeitung und einheitliche Überschriften.

Eine Regel ist für uns nicht verhandelbar: Standardmäßig gilt nur der Entwurf. Ein Modell kann schreiben. Ein Mensch unterschreibt.

Wenn Sie einen Online-Shop betreiben, können Sie Claude auch strukturierte Eingaben (SKU, Eigenschaften, Einschränkungen, Regeln für Werbeaussagen) zuführen und erhalten so einheitliche Produkttexte. Struktur -> führt zu -> Einheitlichkeit bei Hunderten von SKUs.

Kundensupport: Triage, Zusammenfassungen, Antwortvorschläge und Helpdesk-Tagging

Supportarbeit ist Spracharbeit. Das macht sie zu einer idealen Aufgabe für Anthropic AI.

Verwenden Sie Claude, um:

- Fassen Sie lange Ticket-Threads zusammen.

- Schlagen Sie Antworten vor, die Ihren Richtlinien entsprechen.

- Verschlagworten Sie Probleme nach Kategorie und Dringlichkeit.

Qualität der Triage -> wirkt sich aus auf -> die Reaktionszeit. Reaktionszeit -> wirkt sich aus auf -> Rückerstattungen und Bewertungen.

Ein Hinweis: Lassen Sie das Modell niemals Richtlinien festlegen. Die Antworten müssen sich aus Ihren Helpdesk-Makros und Ihrer Wissensdatenbank ergeben.

Backoffice: Dokumentenerfassung, Klassifizierung und einfache Analyse

„Backoffice“ klingt langweilig, was meistens bedeutet, dass es teuer ist.

Claude kann:

- Eingehende Formulare und E-Mails klassifizieren.

- Felder aus PDF-Dateien oder Text extrahieren.

- Erstellen Sie eine kurze Zusammenfassung der Änderungen in den aktualisierten Lieferantenbedingungen.

Genauigkeit der Entnahme -> beeinflusst -> den Umfang der Nachbearbeitung durch das Personal. Nachbearbeitung -> beeinflusst -> ob sich das Werkzeug amortisiert.

Wir beginnen gerne mit einer Dokumentart (zum Beispiel Garantieansprüchen) und werten die Ergebnisse aus, bevor wir fünf weitere hinzufügen.

Sichere Implementierung anthropischer KI: Ein Leitfaden mit Schwerpunkt auf Arbeitsabläufen

Bevor Sie irgendwelche Tools in die Hand nehmen, sollten Sie den Arbeitsablauf genau planen. Teams, die diesen Schritt überspringen, erstellen eine Demo und verbringen dann Monate damit, das Chaos zu beseitigen.

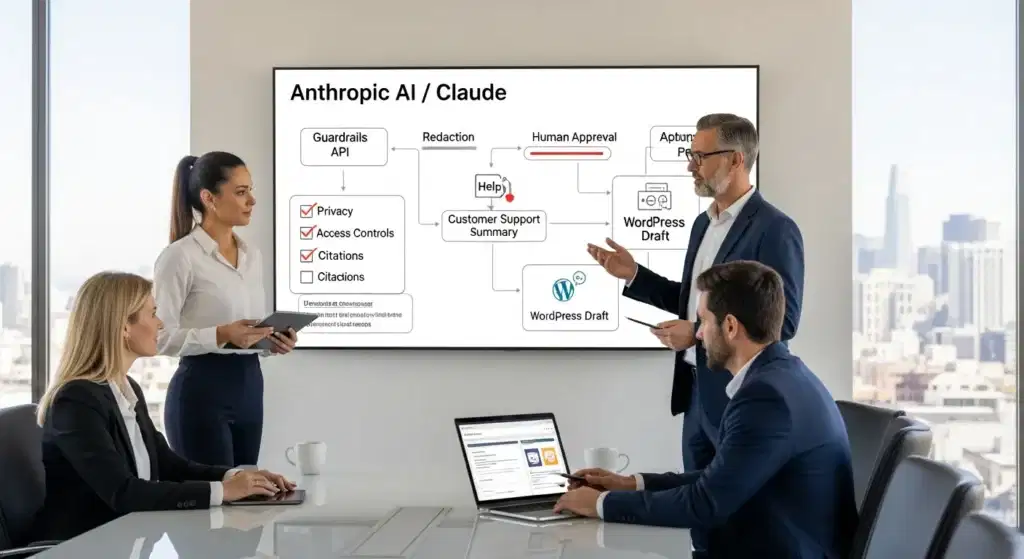

Den Ablauf abbilden: Auslöser → Eingabe → Aufgabe → Ausgabe → Sicherheitsvorkehrungen

Wir verwenden ein einfaches Muster:

- Auslöser: Was löst den Job aus (neues Ticket, neuer WordPress-Beitrag, Formularübermittlung).

- Eingabe: Welche Daten Sie übermitteln (redigierter Text, Produktmerkmale, Auszug aus den Nutzungsbedingungen).

- Aufgaben: Was Claude macht (zusammenfassen, entwerfen, klassifizieren, umschreiben).

- Ausgabe: Wohin das Ergebnis gesendet wird (Entwurf eines Beitrags, CRM-Notiz, Slack-Nachricht).

- Sicherheitsvorkehrungen: Welche Prüfungen werden durchgeführt (Prüfung auf personenbezogene Daten, Liste gesperrter Anträge, manuelle Freigabe)?

Klare Eingaben -> Auswirkungen -> stabile Ergebnisse.

Fang klein an: Schattenmodus, Sampling und Benchmarks zur Zeitersparnis

Fangen Sie klein an. Führen Sie die Automatisierung im „Schattenmodus“ aus. Das bedeutet, dass Claude Ergebnisse liefert, Ihr Team diese aber noch nicht nutzt.

Dann sehen Sie sich die Ergebnisse an:

- Überprüfe 20 Ausgänge.

- Bewerten Sie sie hinsichtlich Genauigkeit, Tonfall und politischer Eignung.

- Erfassen Sie die Zeitersparnis, wenn die Mitarbeiter die Entwürfe nutzen.

Probenahme -> beeinflusst -> Vertrauen. Vertrauen -> beeinflusst -> Akzeptanz.

Prompts als Standardarbeitsanweisungen: Vorlagen, unzulässige Daten und Ablehnungsverhalten

Behandeln Sie Anweisungen als Standardverfahren.

Eine gute Vorlage für eine Eingabeaufforderung enthält:

- Rolle: „Du bist Support-Mitarbeiter bei X.“

- Regeln: „Sammeln Sie keine Zahlungsdaten. Geben Sie keine medizinischen Ratschläge.“

- Eingaben: „Sie erhalten einen Ticket-Thread und einen Auszug aus unseren Richtlinien.“

- Ausgabeformat: „Gib eine ein Absatz lange Zusammenfassung sowie drei Antwortmöglichkeiten aus.“

Regeln -> Auswirkungen -> Ablehnungsverhalten.

Außerdem fügen wir eine Zeile mit „verbotenen Daten“ hinzu, die den Mitarbeitern klarmacht, welche Daten niemals in das Modell gelangen dürfen. Dies verringert versehentliche Datenlecks, da die Regel dort zu finden ist, wo die Mitarbeiter arbeiten, und nicht versteckt in einem PDF-Ordner mit Richtlinien.

Integrationsmuster: No-Code-Automatisierungen und WordPress-Hooks

Anthropic AI entfaltet sein volles Potenzial, wenn Sie es mit den Systemen verbinden, die Ihr Team bereits nutzt. Für viele Teams bedeutet das WordPress, WooCommerce, ein CRM und ein Helpdesk.

Zapier/Make/n8n-Muster: Webhooks, Warteschlangen und Wiederholungsversuche

No-Code-Tools eignen sich besonders gut, wenn es auf Schnelligkeit und lückenlose Nachverfolgbarkeit ankommt.

Von uns verwendete Muster:

- Webhook rein, Webhook raus: Dein Formular oder deine App sendet Daten an eine Automatisierung, Claude verarbeitet sie, und die Automatisierung sendet das Ergebnis zurück.

- Warteschlangen: Eine Warteschlange -> wirkt sich aus auf -> die Zuverlässigkeit bei Verkehrsspitzen, da Aufträge warten, anstatt fehlzuschlagen.

- Wiederholungsversuche mit Begrenzungen: Wiederholungsversuche → wirken sich auf die Stabilität aus, wenn eine API-Ratenbegrenzung erreicht wird.

Hier können Sie auch Redaktionsschritte, Schimpfwortfilter oder einen Schritt zur „menschlichen Freigabe“ hinzufügen, bevor eine Nachricht Ihr Unternehmen verlässt.

WordPress-Tipps: save_post, ACF-Felder, WooCommerce-Ereignisse und Veröffentlichung als Entwurf

WordPress bietet Ihnen übersichtliche Hooks für eine sichere Automatisierung.

Häufige Muster:

- save_post löst einen Claude-Entwurf aus, wenn ein Redakteur einen Beitrag speichert.

- ACF-Felder speichern strukturierte Eingaben wie Zielgruppen, Produktspezifikationen oder Haftungsausschlüsse.

- WooCommerce-Ereignisse (neues Produkt, Bestellhinweis, Rückerstattungsanfrage) lösen Zusammenfassungen oder interne Notizen aus.

- Durch die Veröffentlichung als Entwurf wird verhindert, dass das Modell Inhalte live schaltet.

Hooks -> Auswirkung -> Wiederholbarkeit, da dasselbe Ereignis jedes Mal denselben Job auslöst.

Wenn Ihr Team außerdem möchte, dass die Inhalte für SEO- und KI-Suchfunktionen an der richtigen Stelle erscheinen, können Sie diese Arbeitsabläufe mit den AIO-Schritten aus unserem Leitfaden zur KI-Optimierung für moderne Fachleute kombinieren.

Risiken, Grenzen und Qualitätskontrollen, die Sie einplanen sollten

Anthropic AI kann schnell fehlerfreie Texte erstellen. Es kann aber auch fehlerfreie Texte erstellen, die inhaltlich falsch sind. Dieser Abschnitt hilft Ihnen, vermeidbare Probleme zu vermeiden.

Halluzinationen, Überheblichkeit und wann man Quellenangaben oder Links zu Quellen einfordern sollte

Modelle können zu Fehleinschätzungen führen. Eine Fehleinschätzung -> wirkt sich aus auf -> das Vertrauen der Kunden und das rechtliche Risiko.

Verwenden Sie „Force Citations“-Muster, wenn:

- Sie veröffentlichen Inhalte aus den Bereichen Medizin, Recht, Finanzen oder Sicherheit.

- Du zitierst Statistiken.

- Sie beschreiben Produktfunktionen, die noch bewiesen werden müssen.

Wir fügen oft eine Regel hinzu wie: „Wenn du eine angegebene Quelle nicht zitieren kannst, sag einfach, dass du es nicht weißt.“ Diese eine Zeile -> beeinflusst -> die Ehrlichkeit der Ergebnisse.

Abweichung der Markenstimme, Prompt-Injektion und Verhinderung von Datenlecks

Eine Abweichung der Markenstimme tritt auf, wenn sich der Ton der Veröffentlichungen im Laufe der Wochen allmählich verändert.

Lösungen, die funktionieren:

- Speichern Sie eine kurze Sprachanleitung und fügen Sie sie jedem Auftrag bei.

- Verwenden Sie eine Checkliste für Lektoren, die auf Tonfall, Behauptungen und Haftungsausschlüsse hinweist.

Bei Support-Inhalten und nutzergenerierten Inhalten ist die Gefahr von Prompt-Injection größer. Angriffstext -> beeinflusst -> das Modellverhalten, wenn er ungefiltert eingegeben wird.

Steuerung:

- HTML und Skripte entfernen.

- Schränken Sie die Möglichkeiten des Modells mithilfe von Werkzeugen ein.

- Benutzerinhalte dürfen niemals Vorrang vor den Systemregeln haben.

Das Risiko von Datenlecks sinkt, wenn Sie die Eingaben auf ein Minimum beschränken und vertrauliche Informationen aus den Eingabeaufforderungen heraushalten.

Protokollierung, Zugriffskontrollen und Rollback-Pläne

Behandeln Sie KI-Ergebnisse wie jede andere Änderung in der Produktion.

- Protokollierung: Protokolle -> beeinflussen -> Ihre Möglichkeit, nachzuverfolgen, wer was wann gesendet hat.

- Zugriffskontrollen: Berechtigungen -> Auswirkungen -> Wer darf risikoreiche Aufträge ausführen?

- Rollbacks: Rollbacks -> beeinflussen -> wie schnell Sie sich von einem fehlerhaften Inhaltsbatch oder einer ausgefallenen Automatisierung erholen.

Wenn Sie die Frage „Wer hat diese Ausgabe genehmigt?“ nicht beantworten können, sind Sie noch nicht bereit, diesen Schritt zu automatisieren.

Quellen

- „Constitutional AI: Harmlessness from AI Feedback“ (Forschungsarbeit), Anthropic, Dezember 2022, https://arxiv.org/abs/2212.08073

Fazit

Anthropic AI funktioniert am besten, wenn Sie Claude wie einen kompetenten Assistenten mit klaren Grenzen behandeln und nicht als Ersatz für Ihr eigenes Urteilsvermögen. Die größten Erfolge erzielen wir, wenn Teams einen Arbeitsablauf auswählen, diesen im Schattenmodus testen, die Ergebnisse messen und dann unter Beibehaltung derselben Leitlinien ausweiten.

Wenn Sie Hilfe bei der Anbindung von Anthropic AI an WordPress oder WooCommerce benötigen, ohne Ihre Website in ein wissenschaftliches Experiment zu verwandeln, können wir den Ablauf abbilden, die entsprechenden Kontrollen einrichten und dafür sorgen, dass weiterhin Menschen die Kontrolle behalten.

Häufig gestellte Fragen zu Anthropic AI

Was ist anthropische KI, und was ist sie nicht?

Anthropic AI ist ein in San Francisco ansässiges Unternehmen für KI-Sicherheit und -Forschung (gegründet 2021), das vor allem für seine „Claude“-Familie großer Sprachmodelle bekannt ist. Anthropic AI ist kein „Zaubermitarbeiter“ – Claude generiert Text, kann also Entwürfe erstellen, Zusammenfassungen verfassen und Sprache klassifizieren, kennt jedoch ohne genehmigte Eingaben oder Integrationen keine geschäftlichen Fakten.

Inwiefern unterscheidet sich Anthropic AI von anderen KI-Labors wie OpenAI oder Google?

In der täglichen Arbeit unterscheidet sich Anthropic AI häufig in drei praktischen Aspekten: einer „Safety-First“-Haltung (einschließlich Constitutional AI), flexiblen Unternehmensintegrationsmöglichkeiten (Anthropic API sowie Partner wie Amazon Bedrock) und richtlinienbedingten Einschränkungen wie Länderbeschränkungen. Anstatt sich auf die Frage zu konzentrieren, „wer gewinnt“, sollten Teams das Modell wählen, das den Anforderungen jedes einzelnen Workflows hinsichtlich Risiko, Datenfluss und Compliance am besten entspricht.

Wie lässt sich Anthropic AI (Claude) am besten für WordPress und WooCommerce nutzen?

Anthropic AI spielt seine Stärken dort aus, wo sich sprachliche Aufgaben häufen: Content-Ops (Briefings, Entwürfe, SEO-Bearbeitungen mit menschlicher Überprüfung), Support-Workflows (Ticket-Zusammenfassungen, Antwortvorschläge, Tagging) und Backoffice-Datenerfassung (Klassifizierung, Feldextraktion, „Was hat sich geändert?“-Zusammenfassungen). Lassen Sie es standardmäßig im Entwurfsmodus, füttern Sie strukturierte Eingaben (z. B. SKU-Attribute) ein und verhindern Sie, dass das Modell Richtlinien oder Aussagen erfindet.

Wie lässt sich anthropische KI sicher in geschäftliche Arbeitsabläufe integrieren?

Beginnen Sie mit einem Workflow-orientierten Ansatz: Ordnen Sie Trigger → Eingabe → Job → Ausgabe → Sicherheitsvorkehrungen zu. Führen Sie Claude im Schattenmodus aus und prüfen Sie anschließend die Ausgaben auf Genauigkeit, Tonfall und Richtlinienkonformität, während Sie die eingesparten Minuten erfassen. Behandeln Sie Eingabeaufforderungen als Standardarbeitsanweisungen mit expliziten Regeln (verbotene Daten, Ablehnungsverhalten, Ausgabeformat) und fügen Sie eine menschliche Freigabe sowie Prüfungen wie die Überprüfung auf personenbezogene Daten und eine Liste verbotener Aussagen hinzu.

Was sind die größten Risiken bei anthropischer KI, und wie stellen Sie die Qualität sicher?

Zu den wichtigsten Risiken zählen Halluzinationen (überzeugende, aber falsche Texte), Abweichungen vom Markenstil, das Einfügen von Nutzerinhalten in die Eingabeaufforderung sowie Datenlecks. Zu den wirksamen Kontrollmaßnahmen gehören das Erzwingen von Quellenangaben bei Themen von hoher Bedeutung, das Speichern eines wiederverwendbaren Stilleitfadens, das Entfernen riskanter Eingaben (HTML/Skripte), die Minimierung der gesendeten Daten sowie die Durchsetzung von Protokollierung, Zugriffskontrollen und Rollback-Plänen, damit Sie die Systeme schnell überprüfen und wiederherstellen können.

Kann anthropische KI in regulierten Branchen wie dem Gesundheitswesen, dem Rechtswesen oder dem Finanzwesen eingesetzt werden?

Ja, aber nur unter strenger Aufsicht. Fügen Sie keine vertraulichen Informationen oder personenbezogenen Daten ein, es sei denn, Sie verfügen über einen genehmigten Prozess; nutzen Sie Schwärzungen und rollenbasierten Zugriff. Behalten Sie einen menschlichen Entscheidungsträger für klinische, rechtliche oder finanzielle Beurteilungen bei und verlangen Sie für Aussagen, die auf Behauptungen beruhen, durch Quellen belegte Ergebnisse. Passen Sie zudem Nutzungs- und Marketingaussagen an Leitlinien wie die Empfehlungen der FTC zur Transparenz bei KI an.

Einige der in diesem Beitrag geteilten Links sind Affiliate-Links. Wenn du auf den Link klickst und einen Kauf tätigst, erhalten wir eine Affiliate-Provision, ohne dass dir zusätzliche Kosten entstehen.

Wir verbessern unsere Produkte und Werbung, indem wir mithilfe von Microsoft Clarity analysieren, wie Sie unsere Website nutzen. Durch die Nutzung unserer Website erklären Sie sich damit einverstanden, dass wir und Microsoft diese Daten erfassen und verwenden dürfen. Weitere Informationen finden Sie in unserer Datenschutzerklärung unter .